En el mundo del e-commerce, usar IA para segmentar clientes puede ser muy eficiente, pero también trae riesgos éticos. Si no se toman precauciones, los algoritmos pueden reforzar sesgos, excluir grupos de personas o tomar decisiones injustas. Este artículo ofrece una guía práctica para implementar segmentación ética con IA, cumpliendo con regulaciones como el GDPR y generando confianza en los clientes.

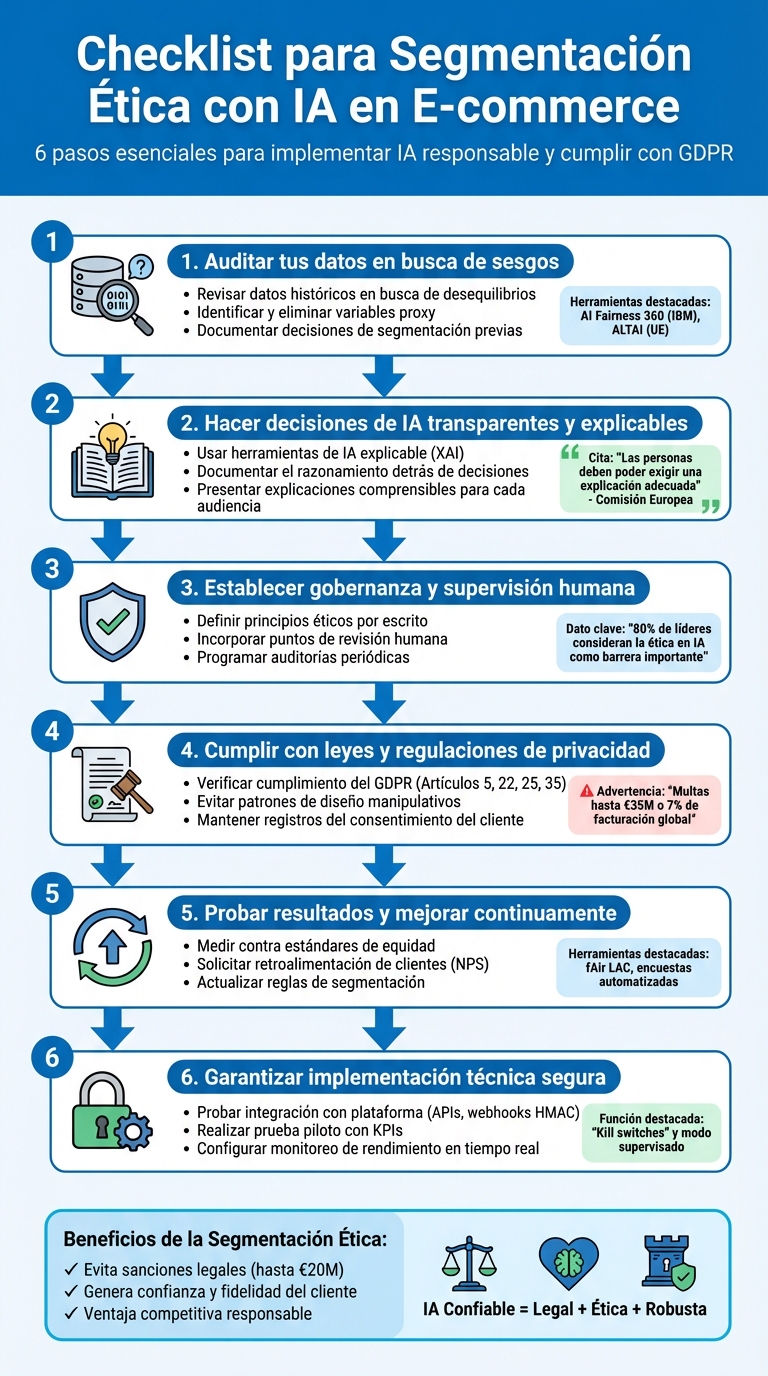

Puntos clave del checklist:

La segmentación ética no solo previene sanciones legales (como multas de hasta €20 millones), sino que mejora la relación con los clientes, quienes valoran marcas responsables. Aplicar este enfoque no es solo una obligación, sino una oportunidad para construir confianza y fidelidad a largo plazo.

6 pasos para implementar segmentación ética con IA en e-commerce

Antes de implementar la segmentación con IA, es fundamental auditar tus datos históricos. Los algoritmos basan su aprendizaje en patrones previos y, si estos incluyen sesgos, el sistema no solo los replicará, sino que también podría amplificarlos. IBM Research lo resume de manera contundente:

"La equidad es una preocupación cada vez más importante a medida que los modelos de aprendizaje automático se utilizan para respaldar la toma de decisiones en aplicaciones de alto riesgo, como préstamos hipotecarios, contratación y sentencias de prisión."

Este análisis inicial es clave para evitar decisiones sesgadas en las etapas siguientes de tu estrategia de segmentación ética. A continuación, se detallan los pasos esenciales para llevar a cabo esta auditoría.

Es importante verificar si los datos reflejan de manera justa a toda tu base de clientes. Esto incluye identificar distribuciones desbalanceadas en aspectos como demografía, ubicación geográfica o patrones de compra. Herramientas como AI Fairness 360 (AIF360) de IBM pueden ayudarte a medir y detectar sesgos tanto en los datos como en los modelos. Además, el marco ALTAI (Assessment List for Trustworthy Artificial Intelligence) de la Comisión Europea permite realizar autoevaluaciones para garantizar que tu sistema respete principios de diversidad, no discriminación y equidad.

Las variables proxy son datos que, aunque no etiqueten directamente características protegidas como género o raza, están fuertemente correlacionados con ellas. Por ejemplo, un código postal podría ser un indicador indirecto del nivel socioeconómico o de la etnia. Según David Leslie, Director de Investigación en Ética e Innovación Responsable del Alan Turing Institute:

"Las prioridades de igualdad y no discriminación... se manifiestan en forma de protección equitativa contra la discriminación directa e indirecta."

Es crucial mapear las categorías sensibles, como datos personales, registros médicos o financieros, e identificar variables proxy que puedan estar encubriendo estas características.

Registrar las decisiones de segmentación tomadas en el pasado es otro paso esencial. Esto implica anotar las variables utilizadas, los responsables de las decisiones, las fechas y las medidas correctivas aplicadas. Este tipo de documentación no solo mejora la explicabilidad del sistema, sino que también es cada vez más exigida por regulaciones como la Ley de IA de la UE. Esta normativa requiere que los proveedores mantengan registros técnicos detallados y publiquen resúmenes de los datos empleados para entrenar los modelos. Tener esta documentación a mano será clave para demostrar cumplimiento normativo en el futuro.

La transparencia no solo es una cuestión ética, sino también una demanda regulatoria cada vez más estricta. Cuando un sistema de IA toma decisiones que afectan a tus clientes, tanto tu equipo como los usuarios deben comprender el razonamiento detrás de cada acción. La Comisión Europea lo expresa claramente:

"Siempre que un sistema de IA tenga un impacto significativo en la vida de las personas, debería ser posible exigir una explicación adecuada del proceso de toma de decisiones del sistema de IA."

Esta capacidad de explicar decisiones, conocida como IA explicable (XAI), resulta clave para generar confianza. Aquí te mostramos cómo garantizar esa trazabilidad.

Implementa herramientas de IA explicable que permitan documentar y rastrear las decisiones tomadas por el sistema, identificando los datos y algoritmos utilizados.

Un análisis sistemático realizado en 2024 destacó varios recursos útiles, como ALTAI, un marco práctico diseñado para cumplir con los estándares de transparencia.

Lleva un registro detallado de cómo se toman las decisiones de segmentación, incluyendo tanto los aspectos técnicos como las decisiones humanas. Esto podría incluir por qué se eligió un modelo específico o cómo influyó una estrategia de negocio en el proceso. Además, documenta los compromisos entre precisión y explicabilidad, ya que optimizar un modelo para ser más preciso puede dificultar su comprensión:

"Cualquier decisión sobre qué compensación hacer debe ser razonada y documentada adecuadamente."

Esta documentación no solo facilita auditorías internas y externas, sino que también mejora la trazabilidad del sistema. Una vez que tengas este razonamiento bien registrado, el siguiente paso es asegurarte de que las explicaciones sean comprensibles para todos.

Un sistema explicable pierde su propósito si las explicaciones no son claras. Estas deben adaptarse al nivel de conocimiento de cada audiencia: usa términos sencillos para los clientes y mayor detalle para reguladores o técnicos. Además, informa a los usuarios cuando están interactuando con un sistema de IA en lugar de una persona, y detalla las capacidades, limitaciones y nivel de precisión del sistema para que puedan evaluar las decisiones de manera justa.

También es crucial ofrecer mecanismos de reparación accesibles. Esto incluye canales claros para que los clientes puedan solicitar intervención humana o cuestionar decisiones automatizadas que consideren equivocadas o injustas. Implementar una automatización de interacciones con IA bien estructurada permite equilibrar la eficiencia con esta necesaria supervisión. Las explicaciones deben ser oportunas y proporcionarse en el momento en que la decisión impacte significativamente al usuario.

Sin reglas claras, las decisiones pueden volverse desordenadas y, en el peor de los casos, irresponsables. Una vez lograda la transparencia en el paso anterior, ahora es crucial implementar una estructura de gobernanza sólida y supervisión humana que defina responsabilidades y puntos de intervención claros. La Comisión Europea lo explica de esta manera:

"La IA confiable tiene tres componentes, que deben cumplirse durante todo el ciclo de vida del sistema: debe ser legal... debe ser ética... y debe ser robusta."

Un dato interesante: el 80% de los líderes empresariales consideran que cuestiones como la explicabilidad, la ética, el sesgo o la confianza en la IA son barreras importantes para su adopción. Además, el mismo porcentaje de organizaciones ya tiene equipos destinados a gestionar los riesgos asociados con la IA. Esto subraya la necesidad de establecer marcos de gobernanza efectivos. A continuación, se detallan las acciones clave para traducir estos principios éticos en medidas concretas.

Con los mecanismos de explicabilidad ya en marcha, es importante documentar los principios éticos que guiarán el uso de la IA. Este documento debe ser claro y abordar temas como:

Este documento no solo debe ser una guía, sino también un compromiso para aplicar estos valores en cada etapa del proceso.

Para llevar estos principios a la práctica, es esencial establecer momentos específicos en los que intervenga un humano. Estos puntos de supervisión pueden dividirse en tres niveles:

En casos de alto riesgo, como decisiones que afectan el acceso a crédito o servicios esenciales, se recomienda crear mecanismos que permitan anular decisiones automatizadas. Además, un sistema de puntuación puede ser útil para decidir el nivel de intervención humana necesario según el impacto potencial de la herramienta.

Las auditorías regulares son fundamentales para garantizar que el sistema se mantenga dentro de los estándares éticos y técnicos. Estas auditorías deben ser realizadas por equipos multidisciplinarios que incluyan expertos legales, técnicos y de políticas. Entre las acciones clave se encuentran:

Para sistemas de alto impacto, se aconseja realizar revisiones externas independientes que aporten una perspectiva objetiva sobre el desempeño y el impacto ético. No olvidemos que, según la Ley de IA de la UE, las multas por incumplimientos pueden llegar hasta €35 millones o el 7% de la facturación anual mundial.

Después de establecer una estructura sólida de gobernanza y supervisión, es fundamental asegurarse de que la segmentación con IA cumpla con las normativas de privacidad aplicables. No hacerlo puede resultar en sanciones económicas importantes: bajo el GDPR y la Ley de IA de la UE, las multas pueden llegar hasta €35 millones o el 7% de la facturación anual global, dependiendo del caso. Según la Oficina del Comisionado de Información (ICO):

"La equidad significa que solo deberías procesar datos personales de maneras que las personas razonablemente esperarían y no usarlos de ninguna forma que pudiera tener efectos adversos injustificados sobre ellas".

El Reglamento General de Protección de Datos (GDPR) exige que los datos personales sean tratados de manera legal, justa y transparente (Artículo 5). En el contexto de la segmentación con IA, esto implica identificar una base legal válida antes de procesar datos. Puede tratarse de consentimiento explícito, interés legítimo o necesidad contractual. Además, el Artículo 22 limita las decisiones automatizadas que tengan efectos legales o de impacto significativo sobre las personas, exigiendo medidas como la posibilidad de intervención humana.

El Artículo 25 establece la obligación de implementar "protección de datos por diseño y por defecto", lo que significa incorporar medidas de privacidad desde el inicio del desarrollo del sistema. Si el sistema se considera de alto riesgo, como en el caso del perfilado a gran escala, es obligatorio realizar una Evaluación de Impacto de Protección de Datos (DPIA) según el Artículo 35. Esta evaluación debe ser un proceso continuo que garantice que la segmentación sea necesaria, proporcional y justa para los consumidores.

Además, es esencial que el diseño de tus interfaces y sistemas respete estos estándares legales.

El diseño de tus interfaces debe respetar el consentimiento de los usuarios y evitar prácticas engañosas. La ICO advierte:

"No deberías procesar datos personales de maneras que sean indebidamente perjudiciales, inesperadas o engañosas para las personas involucradas".

Esto incluye evitar el "function creep", que ocurre cuando se utilizan datos recopilados para un propósito en uno completamente diferente. También es crucial que las opciones de "opt-out" sean tan accesibles como las de aceptación. Para promover la transparencia, se recomienda ofrecer explicaciones en dos niveles: una sobre el proceso (cómo se diseñó el sistema) y otra sobre los resultados (por qué se asignó un segmento específico), utilizando siempre un lenguaje sencillo. Además, es importante revisar constantemente el uso de "variables proxy", como códigos postales que podrían correlacionarse con características protegidas, para prevenir cualquier forma de discriminación indirecta.

La rendición de cuentas requiere que puedas demostrar que todas las actividades de procesamiento cumplen con los principios de privacidad. Esto incluye llevar un registro detallado de cómo y cuándo los clientes dieron su consentimiento para el uso de sus datos en perfilados. Este consentimiento debe ser claro y otorgado de manera libre.

Es recomendable designar un Responsable de Protección de Datos (DPO) que supervise las estrategias de protección y gestione la documentación necesaria. También es útil implementar "Hojas de Datos" para los conjuntos de datos, especificando su origen, licencias y cualquier preprocesamiento realizado, como la anonimización. Además, programá auditorías periódicas de los registros de consentimiento y los logs de decisiones de IA para garantizar que estén actualizados y sean precisos. Como señala Sandra Defelipe Díaz, periodista especializada en tecnología:

"La auditoría de IA no es una carga regulatoria, sino como un pilar estratégico fundamental para gestionar riesgos, fomentar la transparencia y construir la confianza necesaria para prosperar".

Con el cumplimiento normativo asegurado, el siguiente paso será evaluar si la segmentación funciona de manera justa y efectiva en la práctica.

Después de implementar tu segmentación basada en IA, es crucial evaluar si funciona de manera justa y cumple con las normativas legales. El monitoreo constante después de la implementación no es opcional; es indispensable para garantizar que los sistemas sigan operando de forma ética y alineada con los valores establecidos. Según los expertos, uno de los mayores desafíos ha sido acordar una definición universal de equidad en IA. Sin embargo, adoptar un enfoque contextual y enfocado en la sociedad puede ayudar a identificar y gestionar posibles sesgos y discriminaciones.

Es importante definir criterios claros de equidad y documentarlos en métricas específicas que permitan identificar y abordar sesgos injustos. Considera crear una "Declaración de Posición sobre Equidad", donde expliques las métricas seleccionadas y las razones detrás de su elección. Herramientas como fAIr LAC pueden complementar las métricas de ALTAI para detectar errores, sesgos y exclusiones en las diferentes etapas del ciclo de vida de la IA. Evalúa la equidad desde la recopilación de datos hasta el impacto final en tus clientes, asegurando que cada paso sea revisado bajo estos estándares.

Además de los estándares internos, la perspectiva de tus clientes es clave para detectar problemas que podrían pasar desapercibidos para los equipos técnicos. Automatiza la recogida de reseñas a través de encuestas en plataformas de alta interacción como WhatsApp e Instagram. Implementa sistemas de análisis de reseñas que procesen comentarios y conversaciones de soporte, agrupando insights para identificar necesidades insatisfechas o patrones que revelen errores en la segmentación. Usa muestreo estratificado para que las encuestas sean representativas de todos los segmentos de clientes y utiliza las mejores herramientas NPS para ajustar tus estrategias en función de la satisfacción real.

Establece ciclos continuos de retroalimentación que permitan ajustar las reglas de segmentación en función del desempeño del sistema en el mundo real. Al analizar el feedback, prioriza los ajustes según su impacto potencial en las ventas o la gravedad del problema detectado. Asegúrate de registrar cada cambio realizado y programa auditorías periódicas enfocadas en los escenarios de mayor riesgo. Vincula cada modificación a indicadores de equidad y satisfacción del cliente. Los estudios sugieren que la ética debe ser el pilar central de cualquier estrategia que integre IA, creando un marco que garantice que la tecnología respete y promueva valores humanos. Este enfoque iterativo no solo mejora la equidad y el desempeño del sistema, sino que también sienta las bases para revisiones técnicas en el futuro.

Una vez definidas las reglas éticas y de segmentación, el siguiente desafío es integrar la tecnología de forma segura en tu plataforma. Esto no es solo un tema de TI: un error en la integración puede derivar en sesgos no deseados, pérdida de datos o experiencias negativas para los usuarios. Antes de lanzar el sistema, es clave consolidar y verificar la calidad de los datos provenientes de fuentes como CRM, historiales de compra y redes sociales, asegurando que la información procesada sea confiable.

Es fundamental confirmar que las herramientas de segmentación se conecten correctamente con tu plataforma, ya sea Shopify, Tiendanube o VTEX. Para esto, utilizá APIs y webhooks seguros que empleen protocolos como HMAC, lo que permite sincronizar datos críticos sin comprometer la seguridad. Además, los webhooks pueden configurarse para que cualquier cambio en la segmentación active acciones inmediatas en las plataformas vinculadas. Automatizá pruebas de carga, como pruebas de línea base, estrés y picos, dentro de tu pipeline CI/CD, garantizando que el sistema sea capaz de manejar tráfico intenso sin inconvenientes. Una vez completada esta etapa, validá el sistema en un entorno controlado antes de avanzar.

Antes de un despliegue total, realizá una prueba piloto con un grupo reducido de clientes. Esto te permitirá identificar y solucionar problemas antes de escalar. Establecé indicadores clave de rendimiento (KPIs) como tasa de conversión, abandono de carrito, clientes recurrentes y valor promedio de pedido (AOV). Para simular comportamientos de compra y validar la efectividad del sistema, empleá datos sintéticos. Además, implementá grupos de control (holdout groups) para comparar los ingresos generados por los segmentos basados en IA frente a los creados con reglas tradicionales. Como dijo Tolstoy:

"Follow the test (pilot), measure (evaluate), and refine (iterate) roadmap to improve the AI's decision-making and outcomes."

También es recomendable incluir mecanismos de anulación manual ("kill switches") para desactivar segmentos automatizados en caso de detectar patrones inusuales o sesgos durante esta fase. Una vez completada la prueba piloto, asegurate de establecer un sistema de monitoreo continuo que permita detectar y solucionar problemas en tiempo real.

Implementá sistemas de monitoreo en tiempo real para rastrear métricas técnicas clave como latencia, Time to First Byte (TTFB), tasas de error y tiempos de respuesta p99. Esto te permitirá identificar problemas de integración de manera inmediata. Configurá alertas automatizadas para reaccionar ante umbrales críticos y prevenir que las degradaciones de rendimiento afecten la experiencia del cliente. Mantené un registro de auditoría detallado para cada acción impulsada por la IA, asegurando que todas las decisiones sean rastreables y reversibles si es necesario. Una buena práctica es implementar un "Modo Supervisado", donde las acciones propuestas por la IA requieran aprobación humana antes de ejecutarse, especialmente en tareas delicadas o de alto impacto. Como señaló Burbuxa:

"Every decision is trackable, every action reversible."

El panel de monitoreo también debería incluir una función de anulación con un solo clic, permitiendo detener o revertir decisiones de la IA de forma inmediata si se detecta un error. Esto garantiza que el sistema mantenga altos estándares de ética y fiabilidad en todo momento.

La segmentación ética con inteligencia artificial no es solo una cuestión tecnológica; es un eje estratégico clave para garantizar la continuidad y el éxito de tu negocio. Como lo expresó Cyberclick: "En marketing digital, hacer un uso ético de la IA no es opcional, es la base que permite sostener crecimiento, fidelidad y confianza a largo plazo". Cuando los clientes entienden cómo se manejan sus datos y por qué reciben ciertas recomendaciones personalizadas en WhatsApp, esa claridad se traduce en confianza y, finalmente, en lealtad genuina.

Este checklist, que incluye desde auditorías de datos hasta un monitoreo constante, no solo protege tu empresa de posibles sanciones legales - como multas de hasta €20 millones o el 4% de la facturación global - , sino que también fomenta la transparencia y refuerza la relación con tus clientes. Adoptar estas prácticas no se trata únicamente de evitar riesgos legales; es una manera de competir con responsabilidad, alineándote con valores esenciales.

Una estrategia ética en IA se apoya en tres bases fundamentales: debe ser legal (cumplir con las normativas), ética (respetar principios básicos) y sólida (segura tanto técnica como socialmente). Estos pilares deben mantenerse presentes a lo largo de todo el ciclo de vida del sistema, desde su creación hasta su implementación.

Cada acción que tomes utilizando este checklist ayuda a construir un sistema que no solo aporta valor, sino que lo hace de manera responsable, fortaleciendo la confianza de los consumidores. La auténtica innovación ocurre cuando la inteligencia artificial logra inspirar confianza real. En un contexto donde las regulaciones avanzan rápidamente y los consumidores están más informados que nunca, la segmentación ética se convierte en una ventaja competitiva clave. Implementar estos pasos no solo significa cumplir con las normativas: es un camino para crear relaciones sólidas basadas en el respeto y la transparencia.

Para identificar variables proxy que puedan generar discriminación no intencional, es fundamental examinar tanto las relaciones estadísticas como las causales entre las variables y los resultados del modelo. Esto implica realizar auditorías de sesgo y equidad, utilizando análisis de sensibilidad y métricas específicas para evaluar la justicia del modelo. Herramientas como Aequitas o AI Fairness 360 son útiles para detectar proxies que funcionan como sustitutos de atributos sensibles, incluso cuando su influencia no es obvia de manera inmediata. Estas herramientas pueden ser clave para garantizar un análisis más riguroso y minimizar posibles sesgos ocultos.

La segmentación basada en inteligencia artificial permite ajustar mensajes y ofertas a las preferencias y comportamientos específicos de cada usuario. Esto no solo mejora la experiencia de compra, sino que también incrementa la efectividad de las campañas, ya que los usuarios reciben contenido más relevante y atractivo.

Además, esta tecnología puede potenciar canales clave como WhatsApp e Instagram, logrando una comunicación más directa y personalizada. También es una herramienta poderosa para abordar uno de los mayores desafíos del comercio electrónico: los carritos abandonados. Al identificar patrones de comportamiento, la IA puede enviar recordatorios o incentivos que motiven a los usuarios a completar sus compras, lo que se traduce en un aumento de las ventas.

Es fundamental que la implementación de la IA respete siempre la privacidad de los usuarios. Esto implica proteger los datos personales, garantizar la transparencia en su uso y adherirse a estándares internacionales de seguridad y ética. Así, se construye confianza con los consumidores mientras se aprovechan las ventajas de esta tecnología.

La Evaluación de Impacto en la Protección de Datos (DPIA) es obligatoria cuando el uso de inteligencia artificial para segmentación implica un alto riesgo para los derechos y libertades de las personas. Esto aplica, por ejemplo, en situaciones donde se analizan perfiles que pueden influir en decisiones automatizadas o tener efectos significativos en derechos fundamentales, como condiciones económicas o sociales.

El Reglamento General de Protección de Datos (GDPR) establece que este análisis es clave para identificar y reducir riesgos antes de implementar cualquier tecnología que pueda afectar a las personas.