¿Querés mejorar la experiencia de tu chatbot y aumentar conversiones? El A/B testing puede ser la solución.

Un chatbot bien diseñado puede marcar la diferencia en ventas y soporte, pero pequeños errores en la experiencia del usuario pueden frustrar a los clientes. Con A/B testing, podés comparar dos versiones de tu chatbot para descubrir qué funciona mejor, basándote en datos reales, no suposiciones.

Conclusión: El A/B testing transforma a tu chatbot en una herramienta más efectiva y rentable. Probá, medí, mejorá y asegurate de que cada interacción con tu bot sume a tus objetivos.

Evaluar el impacto del A/B testing en la experiencia del usuario (UX) es clave para saber si realmente está funcionando. Las métricas adecuadas no solo te indican qué versión del chatbot tuvo mejor desempeño, sino también en qué áreas específicas necesita ajustes. Sin datos claros, cualquier cambio es un tiro al aire. Estas métricas, basadas en los principios del A/B testing, son esenciales para validar cada mejora en la UX.

Cada una de estas métricas ofrece una perspectiva única sobre la experiencia del usuario, ayudando a identificar áreas de mejora en cada variante probada.

Antes de comenzar con pruebas A/B, es fundamental monitorear el rendimiento del chatbot durante 2 a 4 semanas para establecer una línea base. Por ejemplo, si tu tasa de contención actual es del 55%, podés fijar como meta alcanzar el 65% mediante optimizaciones basadas en los resultados del A/B testing. Este enfoque permite medir avances concretos y validar si los cambios implementados generan mejoras reales.

Es crucial rastrear los momentos en que los usuarios abandonan la conversación. Estos puntos suelen indicar problemas como rutas de interacción poco claras, preguntas confusas o fallos técnicos. Configurá el seguimiento de eventos clave, como cuando el bot no puede responder utilizando su base de conocimiento, para detectar fallas específicas. Estos datos no solo ayudan a reducir los abandonos, sino que también guían las pruebas A/B hacia las áreas más críticas, sentando las bases para optimizar el flujo del chatbot y mejorar las ventas por WhatsApp de manera efectiva.

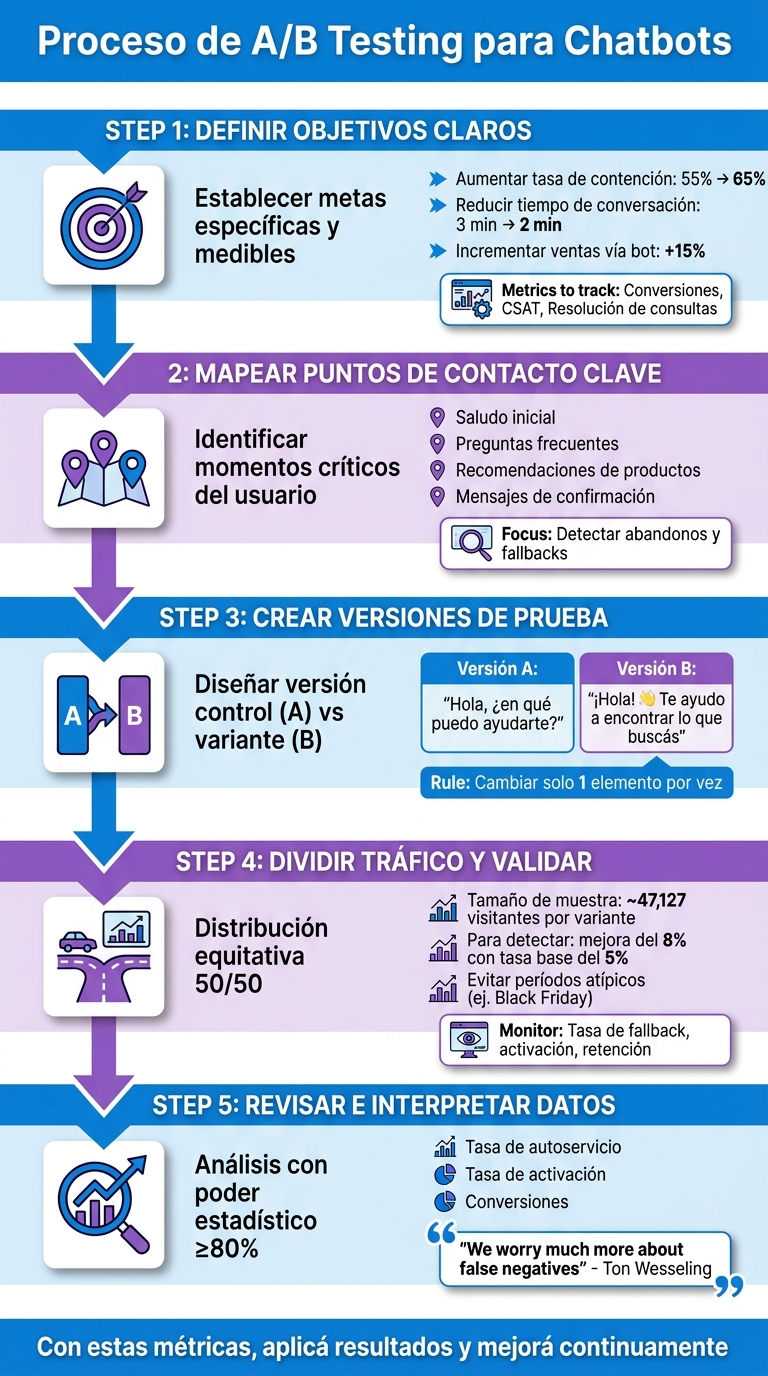

Proceso de A/B Testing para Chatbots en 5 Pasos

Realizar pruebas A/B es un proceso clave para mejorar la experiencia del usuario con un chatbot, asegurándote de que cualquier cambio se base en datos concretos y no en suposiciones. Este enfoque no solo optimiza la interacción, sino que también puede tener un impacto directo en los resultados de tu ecommerce en TiendaNube.

Primero, tenés que establecer qué querés lograr. ¿Querés aumentar la tasa de contención del chatbot de un 55% a un 65%? ¿Reducir el tiempo promedio de cada conversación de 3 a 2 minutos? ¿O quizás incrementar las ventas realizadas a través del bot en un 15%? Es fundamental que cada objetivo esté vinculado a métricas específicas, como conversiones, resolución de consultas o satisfacción del cliente (CSAT), para medir el impacto real en tu negocio.

Identificá los momentos críticos en el recorrido del usuario donde suelen ocurrir problemas, como abandonos o fallas del chatbot al entender las intenciones del usuario (fallbacks). Analizá las conversaciones previas para detectar en qué puntos se pierden más usuarios. Estos momentos pueden incluir el saludo inicial, las respuestas a preguntas frecuentes, las recomendaciones de productos o los mensajes de confirmación. Priorizá estos puntos para comenzar a testear.

Diseñá una versión de control (A) que refleje el flujo actual del chatbot y una variante (B) con un único cambio. Por ejemplo, si querés mejorar la activación, podés comparar un saludo formal como "Hola, ¿en qué puedo ayudarte?" (versión A) con un tono más cercano como "¡Hola! 👋 Te ayudo a encontrar lo que buscás" (versión B). Cambiá solo un elemento por vez, ya sea el tono, la estructura del mensaje o el momento en que se ofrece asistencia humana. Esto te permitirá identificar de manera precisa qué cambio genera una mejora.

Asegurate de distribuir el tráfico de forma equitativa entre ambas versiones, generalmente en partes iguales (50/50). Calculá el tamaño de muestra necesario para obtener resultados confiables; por ejemplo, si querés detectar una mejora del 8% con una tasa de conversión base del 5%, necesitarás aproximadamente 47.127 visitantes por variante. Durante la prueba, monitoreá indicadores como la tasa de fallback, que puede revelar puntos de fricción en la experiencia del usuario. También es importante evitar realizar pruebas en períodos atípicos, como el Black Friday, ya que esos datos no reflejarán el comportamiento habitual de los usuarios.

Una vez alcanzado el tamaño de muestra adecuado, analizá los resultados con un poder estadístico de al menos el 80%. No te apresures a sacar conclusiones, ya que las fluctuaciones iniciales son normales, y es importante que los datos se estabilicen antes de tomar decisiones. Además de las conversiones, evaluá métricas específicas del chatbot, como la tasa de autoservicio (consultas resueltas sin intervención humana) y la tasa de activación (respuesta del usuario tras la interacción inicial), para medir la calidad de la experiencia.

"Many people worry about false positives. We worry much more about false negatives. Why perform experiments where the chances of finding proof of positive impact are really low?" - Ton Wesseling, Founder, Online Dialogue.

Con estas métricas y aprendizajes, estarás listo para aplicar los resultados y seguir mejorando tu chatbot de manera constante.

Con las pruebas A/B definidas, es crucial identificar los elementos del chatbot que influyen directamente en la experiencia del usuario. Cada ajuste puede marcar una gran diferencia en términos de conversiones, satisfacción y eficiencia operativa. Vamos a analizar cada componente con más detalle.

Las rutas de conversación trazan el camino que sigue el usuario desde el primer mensaje hasta completar una acción. Es útil probar flujos orientados a la adquisición frente a aquellos enfocados en la fidelización para ver cuál genera mayor interacción. También podés experimentar con distintas secuencias de venta para identificar qué estructura tiene más probabilidades de convertir o de ofrecer una experiencia más satisfactoria.

Otra estrategia es comparar flujos de autoservicio con rutas que incluyan intervención humana en momentos clave, reduciendo así las pérdidas en el embudo. Además, analizar el embudo del chatbot te permite detectar puntos donde los usuarios abandonan, para luego probar caminos alternativos que reduzcan esas fugas.

El tono que utiliza el chatbot puede ser determinante para cerrar ventas. Probar tonos formales frente a casuales puede ayudarte a encontrar el estilo que más resuena con tu público. Por ejemplo, un estudio de 99helpers reveló que un tono conversacional como "¡Buenas noticias! Tenés 30 días para devolver cualquier artículo" aumentó la tasa de clics en un 12% y mejoró el CSAT en 0,4 puntos.

Además, la elección de palabras en los botones de llamado a la acción (CTA) también es clave. Cambiar un texto genérico como "Comprar" por algo más directo y urgente, como "Comprar ahora", puede ayudar a superar la indecisión del usuario y aumentar las conversiones.

"La forma en que un chatbot interactúa con la audiencia marca la diferencia entre un trato cerrado y una oportunidad perdida" - Germán Viera, Co-Owner & Director de SlideModel.

Los mensajes de error y confirmación son momentos críticos donde se puede ganar o perder la confianza del usuario. Probar diferentes enfoques, desde un tono técnico hasta uno más amigable, puede mejorar la claridad y reducir la frustración. También es importante monitorear palabras o frases que generen confusión y probar alternativas más claras y directas.

Ajustar el tiempo de respuesta del chatbot puede influir en la percepción del usuario. Pequeños retrasos pueden hacer que la interacción se sienta más natural, siempre que no afecten la eficiencia. Usar métricas como la tasa de activación ayuda a medir cuánto tiempo tarda el usuario en responder, lo que permite optimizar el inicio de la conversación.

Por último, experimentar con aspectos visuales como el color, tamaño, posición y contraste de los botones CTA puede generar un impacto considerable en las conversiones. Estos pequeños cambios pueden ser la diferencia entre captar o perder la atención del usuario.

Cuando finalizás una prueba A/B, el primer paso es analizar los resultados para determinar qué versión tuvo un mejor desempeño en las métricas clave. Este análisis no solo cierra el ciclo de pruebas, sino que también abre nuevas oportunidades de mejora. En el caso de los chatbots, es importante enfocarse en métricas como:

Comparar diferentes flujos de interacción te permite identificar cuál genera más participación o logra los objetivos de conversión de manera más eficiente.

Es clave asegurarte de que los resultados sean válidos desde el punto de vista estadístico. Aplicá las mismas herramientas y métodos que usaste al diseñar la prueba. Como dice Ton Wesseling, fundador de Online Dialogue:

"Mucha gente se preocupa por los falsos positivos. Nosotros nos preocupamos mucho más por los falsos negativos. ¿Por qué realizar experimentos donde las probabilidades de encontrar evidencia de que el cambio positivo tiene un impacto son realmente bajas?"

Una vez que tengas identificada la versión ganadora y hayas validado los datos, es momento de implementar mejoras concretas. Documentá cada paso: desde la hipótesis inicial hasta las variantes probadas (incluyendo capturas) y los resultados obtenidos. Este registro no solo evitará que repitas experimentos fallidos, sino que también será útil para capacitar a nuevos integrantes del equipo.

Para priorizar las mejoras, podés usar frameworks como ICE (Impacto, Confianza, Facilidad) o PXL, que te ayudan a evaluar qué cambios ofrecerán el mayor retorno. Al implementar la versión ganadora, hacelo de manera gradual para garantizar una transición fluida y monitoreá de cerca métricas como la tasa de fallback y la tasa de autoservicio. Esto te permitirá confirmar que la experiencia del usuario sigue siendo positiva.

Si ya obtuviste mejoras con pruebas A/B, podés dar el siguiente paso y considerar las pruebas multivariadas (MVT). Estas pruebas te permiten analizar varios elementos al mismo tiempo, como el tono, el momento de los mensajes o los elementos visuales, para encontrar la combinación más efectiva. Sin embargo, necesitás un volumen de tráfico considerablemente mayor para alcanzar resultados estadísticamente significativos.

Rommil Santiago, Director de Estrategia de Soluciones en Optimizely, explica:

"Las pruebas complejas a menudo generan un mayor impacto, aunque requieren tamaños de muestra más grandes"

Antes de avanzar, asegurate de que tu chatbot cuente con una base de usuarios sólida. Es importante equilibrar pruebas A/B rápidas con experimentos multivariados más complejos y de mayor impacto. Además, las experiencias personalizadas - que podés perfeccionar con MVT - generan un 41% más de impacto que las generales y no personalizadas. Estos pasos te permitirán seguir optimizando continuamente la experiencia del usuario.

Burbuxa ofrece herramientas avanzadas para realizar pruebas A/B, diseñadas para mejorar continuamente la experiencia del usuario en chatbots.

Con Burbuxa, el A/B testing se lleva a otro nivel gracias a automatizaciones que ajustan variables clave sin necesidad de intervención humana. El sistema realiza miles de pruebas diarias en flujos como la recuperación de carritos abandonados, confirmaciones de pedidos y ofertas de upselling. Ajusta automáticamente factores como el momento del envío, el mensaje y las ofertas, logrando identificar la combinación más efectiva para cada segmento de clientes.

Este enfoque, impulsado por inteligencia artificial, garantiza que tus flujos no solo se mantengan efectivos, sino que mejoren con el tiempo. Además, podés empezar en menos de 5 minutos usando plantillas optimizadas que ya han sido probadas en más de 500 tiendas. A medida que el sistema aprende del comportamiento específico de tus clientes, realiza ajustes automáticos que se reflejan en análisis en tiempo real.

Los paneles de Burbuxa brindan acceso a métricas actualizadas al instante, como ingresos, tasas de conversión y comportamiento del usuario. Cada flujo, broadcast y experimento incluye datos completos de atribución, como ingresos generados, valor promedio del pedido (AOV) y el impacto en la respuesta a órdenes. Esto te permite identificar rápidamente qué variantes están funcionando mejor.

La plataforma se sincroniza en tiempo real con sistemas como Shopify, Tiendanube o VTEX, integrando datos sobre productos, inventario, pedidos, clientes y descuentos. Esto elimina la necesidad de exportar información manualmente y asegura que tus análisis reflejen siempre el estado actual de tu tienda.

Para garantizar que las optimizaciones sean seguras, Burbuxa incorpora flujos de aprobación que combinan la inteligencia artificial con supervisión humana. El sistema sugiere cambios y ajustes basados en datos, pero requiere validación humana antes de aplicar modificaciones críticas, como cambios en precios o políticas de reembolso. Además, podés establecer umbrales personalizados y tomar el control manual en cualquier momento con un solo clic.

| Característica | Chatbots desconectados | Burbuxa (con flujos de aprobación) |

|---|---|---|

| Toma de decisiones | Completamente autónoma o manual | Propuesta por IA con supervisión humana |

| Riesgo de error | Alto (datos desactualizados o errores) | Bajo (validación humana + sincronización en tiempo real) |

| Tiempo de respuesta | Lento (si es manual) | Promedio de 2,3 segundos |

| Tasa de resolución | Baja | Más del 95% de resolución automática |

| Control | Limitado | Control manual con un clic |

Este enfoque supervisado reduce drásticamente el riesgo de errores, sin comprometer la velocidad ni la eficiencia, permitiéndote optimizar y experimentar con total tranquilidad.

El A/B testing convierte a un chatbot en una herramienta clave tanto para automatización de ventas como para soporte. Como vimos en esta guía, el proceso implica analizar indicadores fundamentales, diseñar experimentos controlados que comparen diferentes versiones de mensajes, flujos y tiempos de respuesta, y usar los resultados para mejorar continuamente la experiencia del usuario.

Es importante entender que la optimización no es algo que se hace una sola vez. Eventos externos como el Black Friday, menciones en los medios o cambios estacionales pueden alterar los resultados obtenidos previamente. Por eso, realizar pruebas de manera continua es crucial: lo que funcionó el mes pasado puede no ser igual de efectivo hoy.

Para facilitar este proceso, herramientas como Burbuxa hacen que la optimización sea mucho más sencilla. Este sistema automatiza miles de pruebas diarias en flujos como recuperación de carritos, confirmaciones de pedidos y promociones de upselling. Además, ajusta automáticamente variables como el momento del envío y el contenido del mensaje. Con paneles en tiempo real, podés identificar rápidamente qué estrategias están generando más ingresos y conversiones. Lo mejor es que podés empezar en menos de 15 minutos con plantillas ya probadas en más de 500 tiendas.

La combinación de inteligencia artificial con la supervisión humana permite experimentar de manera segura, garantizando rapidez y precisión. Cada ajuste se traduce en mejores tasas de conversión, un mayor valor promedio de los pedidos y clientes más satisfechos.

Incorporá el A/B testing como parte de tu estrategia y transformá tu chatbot en una herramienta rentable y medible. Con las herramientas correctas, el proceso es más sencillo de lo que imaginás.

Para garantizar resultados confiables y con relevancia estadística, es ideal que un test A/B se extienda entre 2 y 4 semanas. Este lapso es suficiente para reunir una cantidad adecuada de datos que permita evaluar con precisión el desempeño de las diferentes variantes.

Para que los resultados de una prueba A/B sean realmente precisos, calcular el tamaño de muestra correcto antes de empezar es clave. Este cálculo depende de varios factores, como:

Tener una muestra adecuada asegura que los resultados sean estadísticamente significativos, evitando interpretaciones erróneas o decisiones basadas en datos insuficientes.

Si una variante logra aumentar las ventas pero afecta negativamente el CSAT (Índice de Satisfacción del Cliente), es clave analizar si el crecimiento en ingresos justifica la caída en satisfacción. Una experiencia positiva es fundamental para mantener la lealtad de los clientes y evitar consecuencias negativas a largo plazo. Por ello, podrías considerar ajustar la variante o incluso revertirla para equilibrar los resultados y proteger la relación con tus clientes.